在当今互联网时代,随着网络应用的不断扩展和访问量的急剧增加,如何确保服务的高可用性和稳定性变得尤为重要,服务器负载均衡技术作为一种有效的解决方案,能够通过分散请求到多个服务器上,从而提高系统的整体性能和可靠性,本文将详细介绍服务器负载均衡的概念、工作原理以及具体的配置方法。

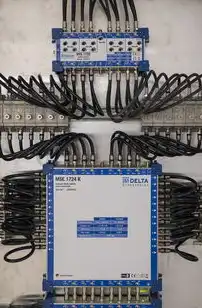

图片来源于网络,如有侵权联系删除

服务器负载均衡概述

服务器负载均衡是一种网络架构设计,旨在通过分配客户端请求到多台服务器上来优化系统资源利用率和提升用户体验,当一台服务器无法承受大量并发连接时,负载均衡设备会将部分流量转发给其他服务器进行处理,这样可以避免单点故障,保证服务的连续性。

服务器负载均衡的工作原理

-

请求分发机制:负载均衡器负责监听外部网络的流量,并根据预设的策略将请求分发至后端的服务器集群中,常见的分发算法包括轮询、最少连接数等。

-

健康检查:为了确保每个后端服务器都处于正常工作状态,负载均衡器会定期执行健康检查,一旦检测到某个服务器异常或宕机,它会立即停止将该服务器的IP地址列入活跃列表,并将后续请求重新路由到其他可用的服务器上。

-

会话保持:在某些情况下,需要维持用户的会话状态,例如在线购物车功能,为此,负载均衡器可以实现会话保持策略,使得同一用户的请求始终由同一个服务器处理。

服务器负载均衡的配置步骤

-

选择合适的负载均衡软件/硬件:

- 软件负载均衡器如Nginx、HAProxy等适合小型网站使用;

- 硬件负载均衡器则更适合大型企业级应用场景。

-

部署前端服务器:

在公网环境下搭建前端服务器,用于接收来自客户的请求并进行初步的处理(如静态页面缓存)。

图片来源于网络,如有侵权联系删除

-

安装与配置负载均衡器:

- 根据所选方案的不同,进行相应的安装和基本设置;

- 配置监听端口和服务组信息;

- 设置健康检查规则和时间间隔;

- 选择分发算法并调整相关参数。

-

添加后端服务器:

- 将实际提供服务的主机加入到负载均衡器的后端服务器池中;

- 检查各主机的健康状况是否符合要求。

-

测试与优化:

- 进行压力测试以验证负载均衡的效果;

- 根据实际情况调整分发策略和阈值设定。

常见问题及解决方法

-

网络延迟过高:可能是由于链路质量不佳或者服务器响应时间过长导致,可以通过更换高速带宽提供商或者升级服务器硬件来解决。

-

负载均衡器单点故障:如果只有一个负载均衡器,那么整个系统就存在潜在的瓶颈风险,建议采用双活或多活模式来提高系统的容错能力。

-

数据同步不一致:对于需要共享数据的业务场景,可能会遇到不同节点之间的数据更新不及时的问题,此时可以考虑引入分布式数据库等技术手段来实现实时同步。

服务器负载均衡技术在现代网络架构中扮演着至关重要的角色,通过对请求的分发和管理,它不仅提高了系统的吞吐量和稳定性,还为用户提供了一个更加流畅的使用体验,在实际应用过程中也需要注意各种潜在的风险和挑战,并及时采取相应的措施加以防范和处理,相信随着技术的不断创新和发展,未来我们将会看到更多高效稳定的负载均衡解决方案涌现出来。

标签: #服务器负载均衡配置教程

评论列表